作者:原创

AI生成技术的不断迭代,让一些AI生成的图片或者视频达到了乱真的地步,比如顶着明星脸直播带货的视频等等,人们难以辨识真假。但是现在,这些AI生成的视频、语音、文字或者图片,都必须标注清楚,让用户能够分辨AI内容的真实来源。

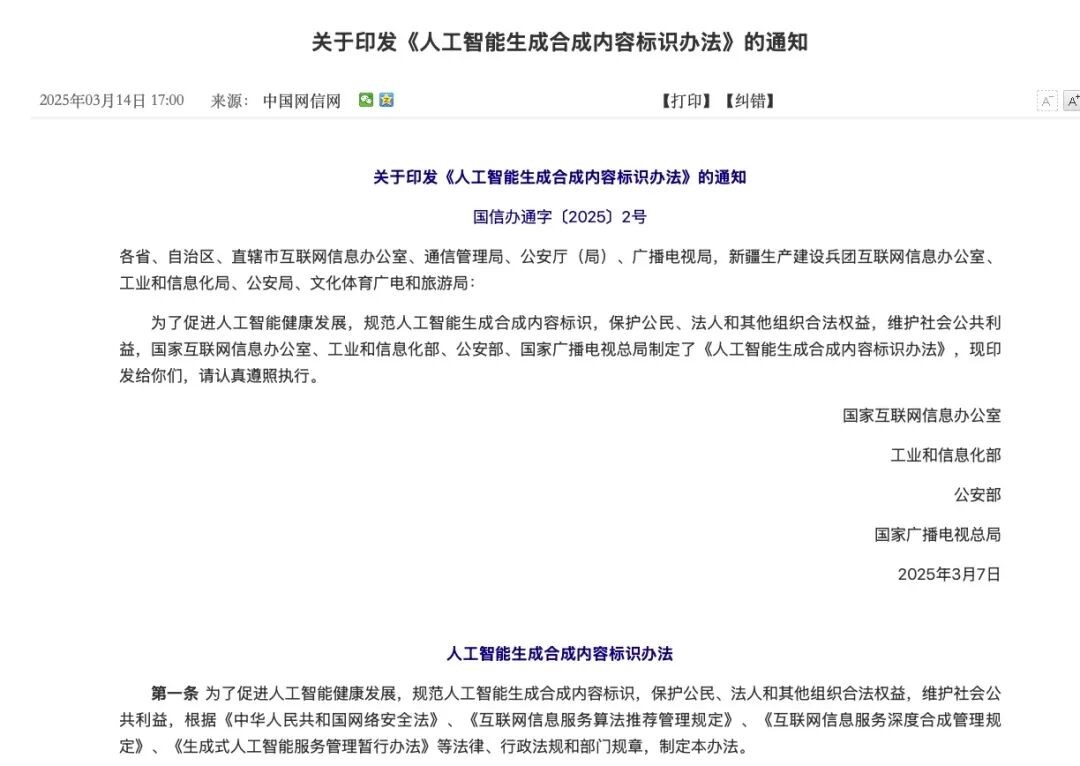

9月1日,由国家互联网信息办公室、工业和信息化部等部门发布的《人工智能生成合成内容标识办法》(以下简称“《办法》”),以及配套《办法》发布的强制性国家标准《网络安全技术人工智能生成合成内容标识方法》同时实施。

截至目前,我国已有490余款大模型在国家网信办完成备案,240余款大模型在省级网信办完成登记,我国生成式人工智能产品的用户规模已达2.3亿人。《标识办法》明确指出,人工智能生成合成内容是指利用人工智能技术生成、合成的文本、图片、音频、视频、虚拟场景等信息。人工智能生成合成内容标识包括显式标识和隐式标识。平台在服务提供者的内容上架或上线时要进行审核,核验生成合成内容标识,对未标识或疑似生成内容要添加风险提示,从而在传播端阻断虚假信息扩散。

据悉,《办法》于3月份发布,9月份正式开始实施。腾讯、抖音、快手、B站、DeepSeek等平台均对上述《办法》出台了各自细化规则。

奇谱科技

奇谱科技